Confianza en la IA: Cómo escalar de manera segura, según el CEO de Stack Overflow

Inteligencia Artificial

¿No sabes por dónde empezar con la IA?Evalúa preparación, riesgos y prioridades en menos de una hora.

➔ Descarga nuestro paquete gratuito de preparación para IA

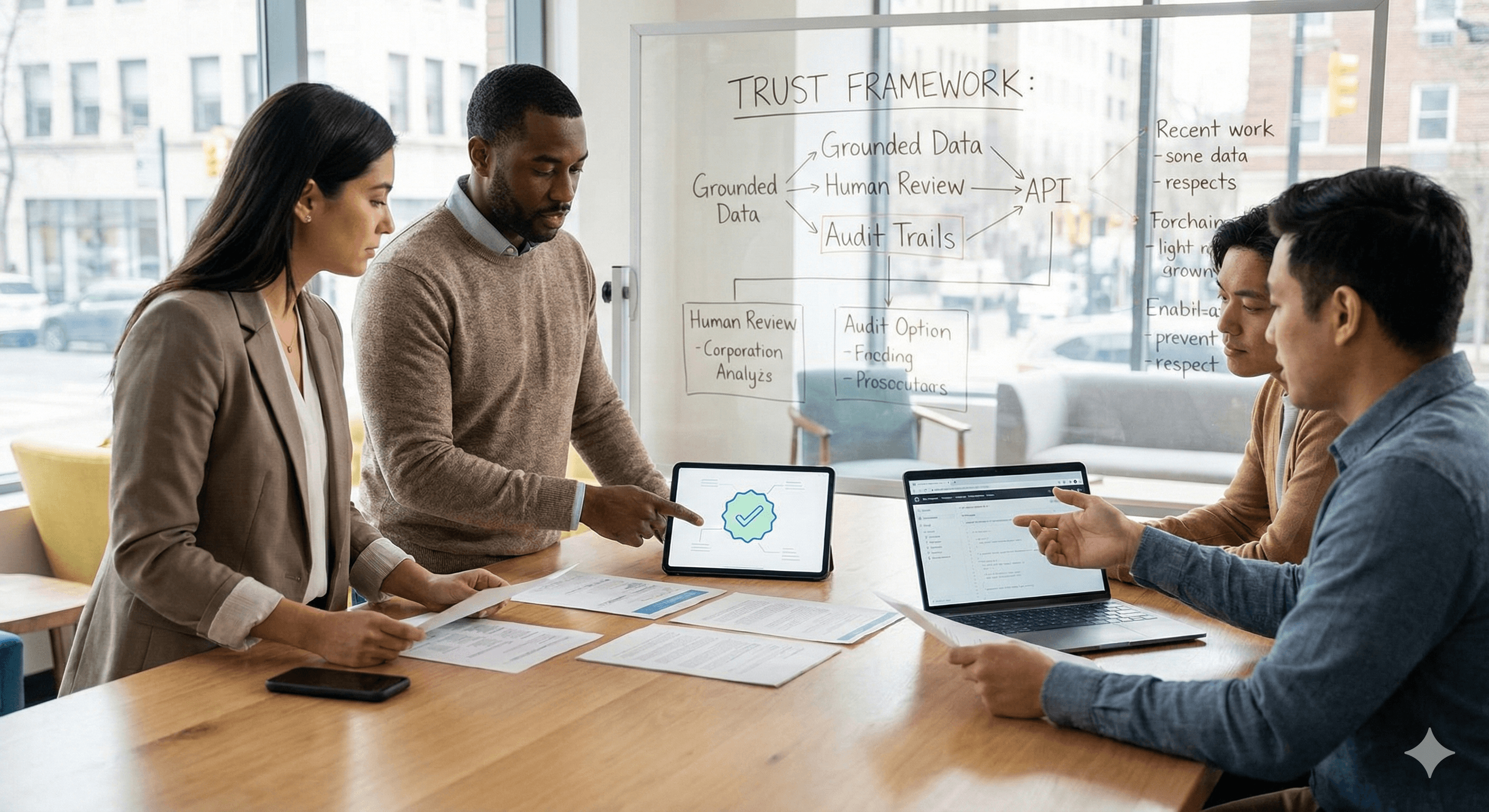

La confianza en la IA es el grado de seguridad que tienen las personas y organizaciones de que los sistemas de IA son fiables, seguros y alineados con políticas y ética. Para escalar la IA, los líderes deben gobernar la calidad de los datos, hacer que los resultados sean auditables e integrar el conocimiento validado por humanos en los flujos de trabajo diarios.

La adopción de la IA avanza rápidamente, pero la confianza a menudo se queda atrás. En una nueva entrevista, el CEO de Stack Overflow, Prashanth Chandrasekar, explica por qué las empresas se detienen después de los pilotos y cómo una mejor calidad de conocimiento, gobernanza y experiencia del desarrollador desbloquean el escalado. Aquí está en lo que los líderes deberían actuar ahora.

Por qué la confianza, no las herramientas, decide la IA a escala

Muchas organizaciones pueden presentar una demostración. Pocas pueden implementar sistemas confiables en equipos. La diferencia es la confianza: resultados consistentes y explicables; lineage de datos transparente; y responsabilidad clara de modelo a decisión. La entrevista de McKinsey se centra en estos mecanismos organizacionales en lugar de solo modelos o infraestructura.

Haz de la calidad del conocimiento tu fundamento

Las empresas necesitan una fuente única de verdad para códigos, políticas y experiencia de dominio. Chandrasekar enfatiza el conocimiento validado por humanos: respuestas curadas, patrones de codificación, decisiones de arquitectura, como la base que hace que la IA sea confiable en el desarrollo diario. Los sistemas construidos sobre conocimiento comprobado son más fáciles de auditar y mejorar.

Movimientos prácticos

Establece una capa de “conocimiento como servicio”: estándares codificados, documentos de diseño y registros de decisiones que la IA puede recuperar.

Utiliza la generación mejorada por recuperación (RAG) para fundamentar los resultados de la IA en ese corpus; requiere citas en las respuestas.

Rastrea la aceptación de respuestas y el uso posterior para medir la confianza.

Entrevistas recientes reflejan el mismo patrón: los desarrolladores usan mucho la IA pero confían selectivamente en ella—por lo que basar las respuestas en conocimiento revisado es crítico.

Trata a los desarrolladores como el motor de confianza

Los desarrolladores son tanto los primeros en adoptar como la primera línea de defensa. La entrevista señala la evolución del sentimiento sobre la asistencia de IA: los equipos abrazan los aumentos de velocidad pero insisten en la revisión de código, pruebas y procedencia. Incorpora prácticas de confianza donde los desarrolladores trabajan—IDE, repositorios, CI/CD—en lugar de en paneles separados.

Qué implementar

Barreras de política como código en procesos (licencias, secretos, riesgos por dependencias).

Pruebas unitarias y basadas en propiedades obligatorias para el código generado por IA.

Plantillas de solicitudes de extracción que requieren fuentes cuando la IA contribuyó.

Gobierna para escalar: roles claros, resultados auditables

No puedes confiar en “los mejores esfuerzos” a medida que el uso crece. Define quién aprueba modelos, quién posee los instructivos y cómo revertir fracasos. Mantén un rastro de auditoría desde el instructivo hasta la decisión de producción. Los líderes entrevistados por McKinsey & Company consistentemente vinculan la confianza con la disciplina operativa, no con eslóganes.

Un modelo operativo simple

Producto posee el valor del caso de uso y los criterios de aceptación.

Ingeniería posee la integración, resiliencia y puntos de referencia.

Datos/ML posee la selección, evaluación y deriva del modelo.

Riesgo/Legal posee la política, propiedad intelectual y alineación regulatoria.

Comunicación Interna posee la transparencia con los empleados.

Mide la confianza de la misma manera que mides la confiabilidad

Adopta métricas al estilo SLO para IA: tasa de respuestas fundamentadas, tasa de cobertura de citas, tasa de resultados dañinos y tiempo de reversión. Publica estas como estadísticas de confiabilidad. Varias entrevistas de 2025 con líderes de la industria refuerzan que las organizaciones exigirán ROI verificable y calidad, no experimentación por el mero hecho.

Construye con comunidades, no solo para ellas

El punto de vista de Stack Overflow muestra que las normas comunitarias—revisión, votación, curación—son un mecanismo escalable para la calidad. Toma prestado ese patrón de “humano en el bucle” dentro de tu empresa: juntas de revisión de expertos para instructivos y patrones; reconocimiento de contribuyentes en marcos de rendimiento; rutas claras para escalar errores.

Cinco acciones para tomar este trimestre

Inventario de conocimiento: cataloga los documentos, patrones y políticas en los que tu IA debería confiar; arregla contenido redundante, obsoleto, trivial (ROT).

Fundamenta todo: requiere RAG con fuentes humanas curadas para asistentes de producción.

Prueba de verdad: agrega pruebas adversariales y basadas en propiedades a los chequeos de PR para código impactado por IA.

Instrumenta la confianza: registra instructivos, fuentes, citas y aprobación del revisor; informa la tasa de respuestas fundamentadas semanalmente.

Mejora habilidades de equipos: capacita a desarrolladores y líderes de productos en evaluación, sesgo y procedencia; conviértelo en parte de la excelencia en ingeniería.

¿Qué significa esto para las organizaciones del Reino Unido?

Las juntas del Reino Unido están pidiendo evidencia de que la IA es segura, legal y materialmente valiosa. Un enfoque centrado en la confianza—calidad de conocimiento, procesos auditables, guías centradas en el desarrollador—reduce el riesgo mientras acelera la entrega. Así es como se pasa de “piloto prometedor” a un impacto a nivel empresarial. La cobertura reciente destaca que la adopción supera la confianza; los ganadores convierten la confianza en una competencia.

Lectura adicional de McKinsey sobre IA en desarrollo de software menciona conocimiento como servicio y escalamiento centrado en el desarrollador—contexto útil junto a la entrevista.

Preguntas frecuentes

P1: ¿Qué es «confianza en la IA» en un contexto empresarial?

Es una confianza medible de que las salidas de la IA son precisas, seguras y cumplen con las políticas, respaldadas por gobernanza, auditorías y conocimiento validado por humanos.

P2: ¿Cómo aumentar la confianza de los desarrolladores en los asistentes de IA?

Basa las respuestas en conocimiento revisado, requiere citas, aplica pruebas al código generado por IA y mantiene a los humanos en los ciclos de revisión.

P3: ¿Qué métricas demuestran que la IA es confiable a escala?

Tasa de respuestas fundamentadas, cobertura de citas, tasa de resultados dañinos, puntuaciones de evaluación en puntos de referencia internos y tiempo de reversión.

P4: ¿Por qué los pilotos de IA tienen éxito pero el escalamiento fracasa?

Los pilotos pasan por alto la gobernanza y dependen de expertos; a escala se necesita conocimiento codificado, roles y procesos auditables.

Recibe noticias y consejos sobre IA cada semana en tu bandeja de entrada

Al suscribirte, das tu consentimiento para que Generation Digital almacene y procese tus datos de acuerdo con nuestra política de privacidad. Puedes leer la política completa en gend.co/privacy.

Generación

Digital

Oficina en Reino Unido

Generation Digital Ltd

33 Queen St,

Londres

EC4R 1AP

Reino Unido

Oficina en Canadá

Generation Digital Americas Inc

181 Bay St., Suite 1800

Toronto, ON, M5J 2T9

Canadá

Oficina en EE. UU.

Generation Digital Américas Inc

77 Sands St,

Brooklyn, NY 11201,

Estados Unidos

Oficina de la UE

Software Generación Digital

Edificio Elgee

Dundalk

A91 X2R3

Irlanda

Oficina en Medio Oriente

6994 Alsharq 3890,

An Narjis,

Riad 13343,

Arabia Saudita

Número de la empresa: 256 9431 77 | Derechos de autor 2026 | Términos y Condiciones | Política de Privacidad