Faites confiance à l'IA - Comment évoluer en toute sécurité, par le PDG de Stack Overflow

IA

Pas sûr de quoi faire ensuite avec l'IA?Évaluez la préparation, les risques et les priorités en moins d'une heure.

➔ Téléchargez notre kit de préparation à l'IA gratuit

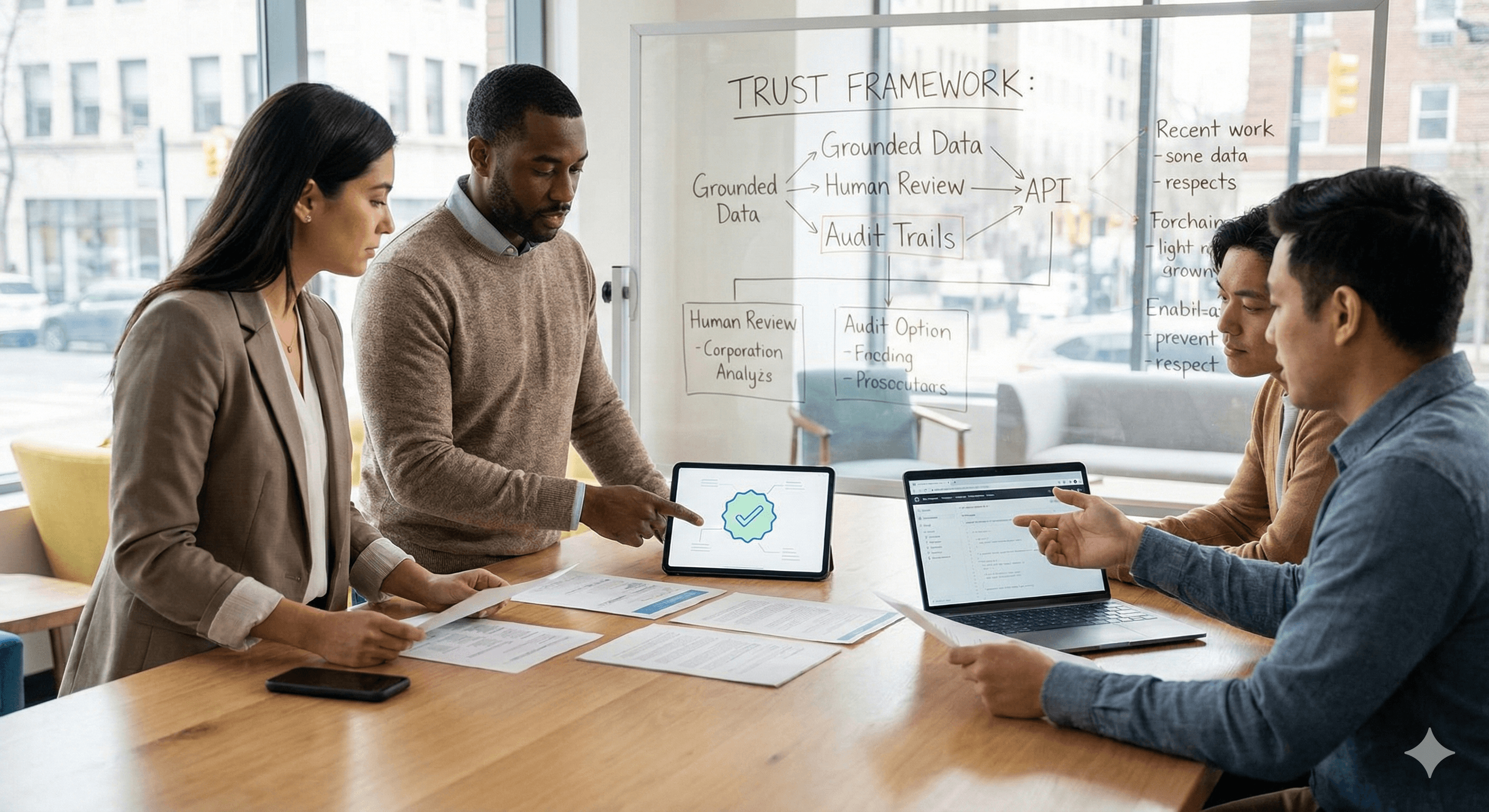

La confiance dans l'IA est le niveau de certitude que les personnes et les organisations ont quant à la fiabilité, la sécurité et l'alignement des systèmes d'IA avec les politiques et l'éthique. Pour développer l'IA, les dirigeants doivent gérer la qualité des données, rendre les résultats auditable et intégrer des connaissances validées par les humains dans les workflows quotidiens.

L'adoption de l'IA progresse rapidement—mais la confiance est souvent à la traîne. Dans une nouvelle interview, le PDG de Stack Overflow, Prashanth Chandrasekar, explique pourquoi les entreprises s'arrêtent après les pilotes et comment une meilleure qualité des connaissances, une gouvernance efficace et une meilleure expérience des développeurs permettent de réaliser l'échelle. Voici ce sur quoi les dirigeants devraient agir maintenant.

Pourquoi la confiance—pas les outils—décide de l'IA à grande échelle

De nombreuses organisations peuvent lancer une démo. Peu d'entre elles peuvent déployer des systèmes fiables dans leurs équipes. La différence réside dans la confiance : des résultats cohérents et explicables; une traçabilité transparente des données; et une responsabilité claire du modèle à la décision. L'interview de McKinsey se concentre sur ces leviers organisationnels plutôt que sur les seuls modèles ou infrastructures.

Faites de la qualité des connaissances votre fondation

Les entreprises ont besoin d'une source unique de vérité pour le code, les politiques, et le savoir-faire de domaine. Chandrasekar souligne l'importance des connaissances validées par l'humain—réponses sélectionnées, motifs de codage, décisions architecturales—comme le substrat qui rend l'IA fiable dans le développement quotidien. Les systèmes construits sur des connaissances vérifiées sont plus faciles à auditer et à améliorer.

Actions pratiques

Mettre en place une couche de “connaissance comme service” : normes codifiées, documents de conception et registres de décisions que l'IA peut récupérer.

Utiliser la génération augmentée par la récupération (RAG) pour ancrer les sorties de l'IA dans ce corpus; exiger des citations dans les réponses.

Suivre l'acceptation des réponses et l'utilisation en aval pour mesurer la confiance.

Les récents entretiens reflètent le même schéma : les développeurs utilisent beaucoup l'IA mais lui font confiance de manière sélective—ancrer les réponses dans des connaissances vérifiées est donc crucial.

Traitez les développeurs comme le moteur de confiance

Les développeurs sont à la fois les premiers adoptants et la première ligne de défense. L'interview met en lumière le sentiment évolutif à propos de l'assistance IA : les équipes adorent les gains de vitesse mais insistent sur la revue de code, les tests, et la provenance. Intégrez les pratiques de confiance là où les développeurs travaillent—IDE, dépôts, CI/CD—plutôt que dans des tableaux de bord séparés.

Ce qu'il faut implémenter

Des garde-corps de politique comme code dans les pipelines (licences, secrets, risques de dépendance).

Tests unitaires et basés sur les propriétés obligatoires pour le code généré par l'IA.

Des modèles de demandes de tirage qui exigent des sources lorsque l'IA a contribué.

Gouverner pour l'échelle : rôles clairs, résultats auditables

Vous ne pouvez pas compter sur les “meilleurs efforts” à mesure que l'utilisation croît. Définissez qui approuve les modèles, qui possède les prompts, et comment vous rétablissez les échecs. Gardez une piste d'audit du prompt à la production. Les dirigeants interrogés par McKinsey & Company lient constamment la confiance à la discipline opérationnelle, pas aux slogans.

Un modèle d'exploitation simple

Produit détient la valeur des cas d'utilisation et les critères d'acceptation.

Ingénierie détient l'intégration, la résilience, et les repères.

Data/ML détient la sélection du modèle, l'évaluation, et la dérive.

Risque/Juridique détient la politique, la propriété intellectuelle, et l'alignement réglementaire.

Communication Interne détient la transparence avec les employés.

Mesurez la confiance comme vous mesurez la fiabilité

Adoptez des métriques de type SLO pour l'IA : taux de réponses fondées, taux de couverture des citations, taux de sorties nuisibles, et temps de rétablissement. Publiez-les comme des statistiques de fiabilité. Plusieurs entretiens de 2025 avec des leaders de l'industrie renforcent que les organisations exigeront un retour sur investissement vérifiable et de la qualité, pas de l'expérimentation seulement pour elle-même.

Construisez avec les communautés, pas seulement pour elles

Le point de vue de Stack Overflow montre que les normes communautaires—revue, vote, curation—sont un mécanisme évolutif pour la qualité. Empruntez ce modèle “human-in-the-loop” au sein de votre entreprise: des comités d'experts pour les prompts et les motifs; reconnaissance des contributeurs dans les cadres de performance; voies claires pour signaler les erreurs.

Cinq actions à entreprendre ce trimestre

Inventoriez les connaissances: cataloguez les documents, motifs, et politiques que votre IA devrait faire confiance; corrigez le contenu ROT (redondant, obsolète, trivial).

Ancrez tout: exigez le RAG avec des sources human-curated pour les assistants de production.

Testez sérieusement: ajoutez des tests adverses et basés sur les propriétés aux vérifications de PR pour le code touché par l'IA.

Instrumentez la confiance: consignez les prompts, sources, citations, et approbation des réviseurs; rapportez le taux de réponses fondées chaque semaine.

Améliorez les équipes: formez les développeurs et chefs de produit sur l'évaluation, les biais et la provenance; faites-en une partie de l'excellence en ingénierie.

Ce que cela signifie pour les organisations britanniques

Les conseils britanniques demandent des preuves que l'IA est sûre, légale, et matériellement valable. Une approche centrée sur la confiance—qualité des connaissances, pipelines auditables, garde-corps centrés sur les développeurs—réduit les risques tout en accélérant la livraison. C'est ainsi que vous passez d'un “pilote prometteur” à un impact d'entreprise. La couverture récente souligne que l'adoption dépasse la confiance; les gagnants transforment la confiance en une compétence.

Lectures supplémentaires de McKinsey sur l'IA dans le développement logiciel mentionne la connaissance comme un service et l'échelonnement centré sur les développeurs—contexte utile en parallèle de l'interview.

FAQ

Q1: Qu'est-ce que la “confiance dans l'IA” dans le contexte d'entreprise ?

C’est une certitude mesurable que les résultats de l'IA sont précis, sûrs, et conformes aux politiques—soutenus par la gouvernance, les audits, et les connaissances validées par les humains.

Q2: Comment augmenter la confiance des développeurs dans les assistants IA ?

Ancrez les réponses dans des connaissances vérifiées, exigez des citations, appliquez des tests sur le code généré par l'IA, et gardez les humains dans les boucles de révision.

Q3: Quels sont les indicateurs qui prouvent que l'IA est digne de confiance à grande échelle ?

Taux de réponses fondées, couverture des citations, taux de sorties nuisibles, scores d'évaluation sur des benchmarks internes, et temps de rétablissement.

Q4: Pourquoi les pilotes d'IA réussissent alors que le passage à l'échelle échoue ?

Les pilotes contournent la gouvernance et font confiance aux experts; à grande échelle, vous avez besoin de connaissances codifiées, de rôles et de processus auditables.

Recevez chaque semaine des nouvelles et des conseils sur l'IA directement dans votre boîte de réception

En vous abonnant, vous consentez à ce que Génération Numérique stocke et traite vos informations conformément à notre politique de confidentialité. Vous pouvez lire la politique complète sur gend.co/privacy.

Génération

Numérique

Bureau du Royaume-Uni

Génération Numérique Ltée

33 rue Queen,

Londres

EC4R 1AP

Royaume-Uni

Bureau au Canada

Génération Numérique Amériques Inc

181 rue Bay, Suite 1800

Toronto, ON, M5J 2T9

Canada

Bureau aux États-Unis

Generation Digital Americas Inc

77 Sands St,

Brooklyn, NY 11201,

États-Unis

Bureau de l'UE

Génération de logiciels numériques

Bâtiment Elgee

Dundalk

A91 X2R3

Irlande

Bureau du Moyen-Orient

6994 Alsharq 3890,

An Narjis,

Riyad 13343,

Arabie Saoudite

Numéro d'entreprise : 256 9431 77 | Droits d'auteur 2026 | Conditions générales | Politique de confidentialité